歐姆龍研發(fā)出業(yè)內(nèi)最快的機器人3D視覺傳感技術(shù)

日前,歐姆龍公司宣布,該公司已研發(fā)出據(jù)稱是業(yè)內(nèi)最快的3D視覺傳感技術(shù),用于緊湊型視覺傳感器,可三維識別目標物體的位置和方向。通過將這種技術(shù)與機器人相結(jié)合,可以使傳統(tǒng)的人工密集型流程自動化,從而快速、準確地組裝散裝零件。基于該技術(shù)的緊湊型3D視覺傳感器計劃于2020年實現(xiàn)商業(yè)化。

近年來,隨著勞動力短缺的加劇和勞動力成本的增加,裝配、檢驗和運輸?shù)冗^程的自動化勢在必行,而這些過程在很大程度上依賴于人們的經(jīng)驗和感覺。然而,要在裝配過程中自動挑選由人類完成的大宗零件,機器人需要配備“眼睛”,這就需要能夠立即識別零件位置和方向的高速3D視覺傳感技術(shù)。為此,無論是3D測量兩部分技術(shù)生成的3D形狀圖像,還是識別目標物體位置和方向的3D識別都需要更快的速度。

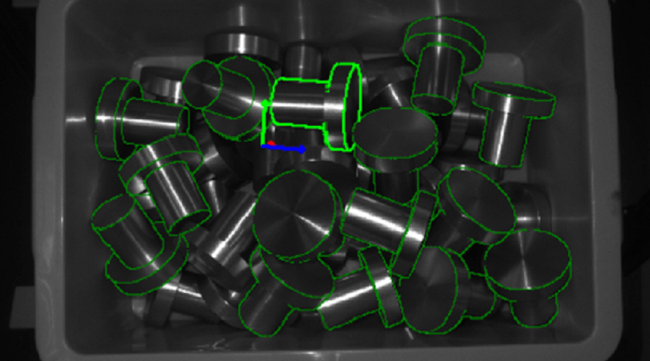

為了滿足這一需求,歐姆龍開發(fā)了一種3D視覺傳感技術(shù)。這項新技術(shù)實現(xiàn)了高速、高精度的3D物體識別,并提供了一種可安裝在機器人手上的小巧輕便的視覺傳感器。盡管使用相移方法的傳統(tǒng)3D測量技術(shù)進行測量需要時間,因為需要捕獲10個或更多圖像,但歐姆龍開發(fā)了一種3D測量技術(shù),能夠使用專有模式照明在一次拍攝中生成目標物體的3D圖像。

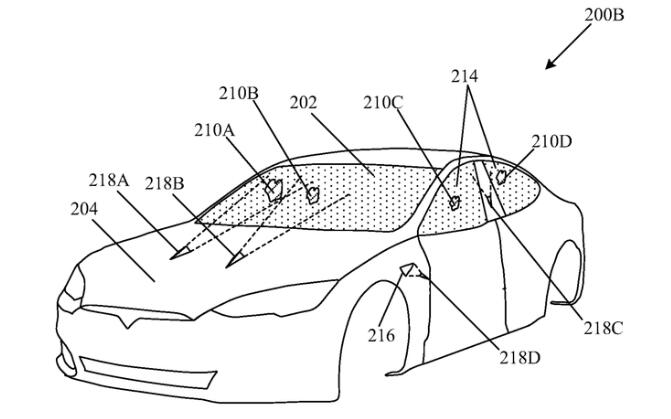

此外,歐姆龍還將其在圖像處理領(lǐng)域積累的高速2D搜索技術(shù)擴展到3D領(lǐng)域,為3D識別技術(shù)開發(fā)了一種高速目標位置和方向識別算法。這些技術(shù)允許在大約0.5秒內(nèi)對流體部件進行高速部分識別。同時,安裝在緊湊型機械手上的相機成為可能,因為歐姆龍的專有模式照明將相機的尺寸和重量減小到大約500克。

3D視覺傳感器的視覺點可以根據(jù)部件設(shè)置來移動,從而允許在不同位置和方向靈活地拾取零件。一個機器人結(jié)合了一個3D視覺傳感器,可以在多個零件容器中挑選散裝零件。它需要大約0.5秒來拍攝一個部分的圖像并識別它的位置和方向。

登錄

登錄

注冊

注冊